什么是模型上下文协议(MCP)?它如何相比API简化AI集成

2025年3月7日 · 阅读时间7分钟

**MCP(模型上下文协议)**是一种新的开放协议,旨在标准化应用程序如何为大型语言模型(LLM)提供上下文。

可以将MCP想象成AI代理的USB-C端口:它提供了一种统一的方法来连接AI系统与各种工具和数据源。

本文将详细解析MCP,清晰地解释其价值、架构以及它与传统API的区别。

什么是MCP?

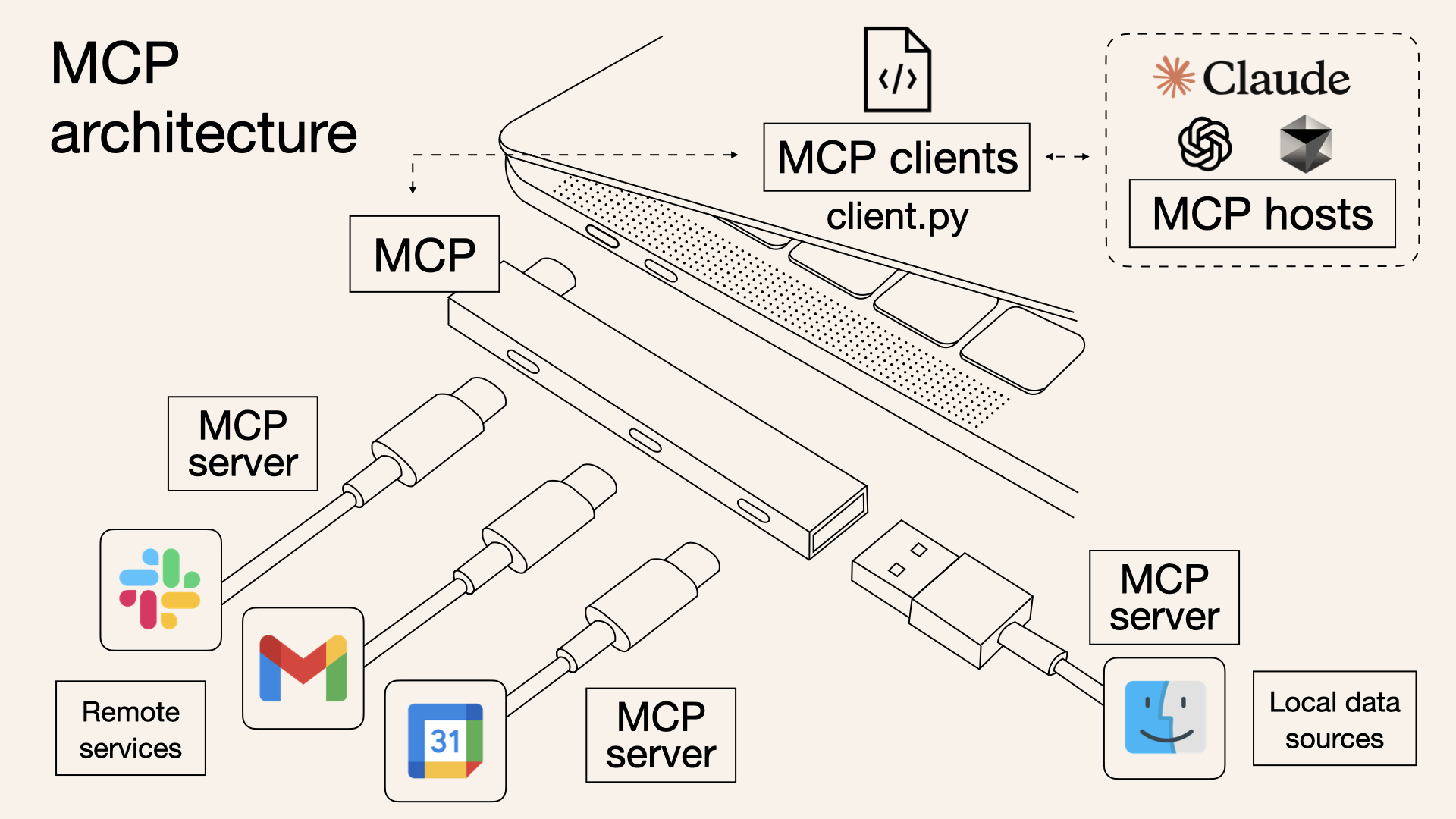

模型上下文协议(MCP)是一种标准化协议,用于连接AI代理与各种外部工具和数据源。可以将其想象为USB-C端口 - 但是用于AI应用程序。

MCP架构示意图:

**模型上下文协议(MCP)**是一种标准化协议,用于连接AI代理与各种外部工具和数据源

就像USB-C简化了不同设备与计算机的连接方式一样,MCP简化了AI模型与您的数据、工具和服务的交互方式。

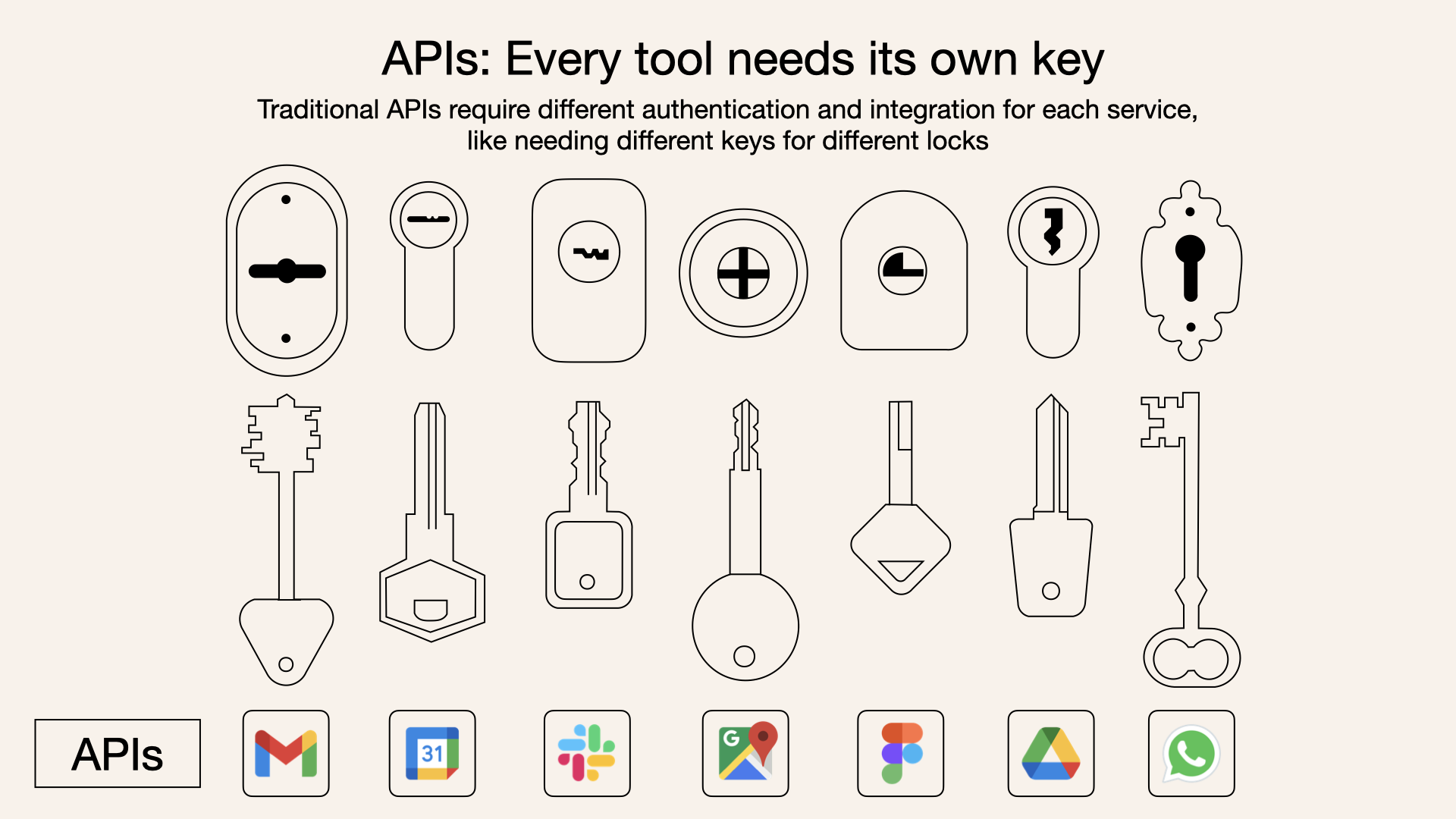

为什么使用MCP而不是传统API?

传统上,将AI系统连接到外部工具涉及集成多个API。每个API集成意味着需要单独的代码、文档、认证方法、错误处理和维护。

为什么传统API就像为每扇门配备单独的钥匙

打个比方: API就像单独的门 - 每扇门都有自己的钥匙和规则:

传统API示意图:

传统API要求开发者为每个服务或数据源编写自定义集成

谁在支持MCP?

MCP(模型上下文协议)最初是由Anthropic发起的项目,旨在让AI模型 - 如Claude - 更容易与工具和数据源交互。

但它不再仅仅是Anthropic的项目。MCP是开放的,越来越多的公司和开发者正在加入。

它开始看起来很像AI-工具交互的新标准。

想深入了解?官方MCP规范和持续开发可以在modelcontextprotocol.io找到。

MCP与API:快速比较

| 特性 | MCP | 传统API |

|---|---|---|

| 集成工作量 | 单一、标准化集成 | 每个API需要单独集成 |

| 实时通信 | ✅ 支持 | ❌ 不支持 |

| 动态发现 | ✅ 支持 | ❌ 不支持 |

| 可扩展性 | 容易(即插即用) | 需要额外集成 |

| 安全性与控制 | 跨工具一致 | 因API而异 |

MCP与传统API的关键区别:

- 单一协议: MCP作为标准化的"连接器",因此集成一个MCP意味着可能访问多个工具和服务,而不仅仅是一个

- 动态发现: MCP允许AI模型动态发现并与可用工具交互,无需硬编码每个集成的知识

- 双向通信: MCP支持持久的、实时的双向通信 - 类似于WebSockets。AI模型可以既检索信息又动态触发操作

为什么需要双向通信?

MCP提供实时、双向通信:

- 拉取数据: LLM查询服务器获取上下文 → 例如检查您的日历

- 触发操作: LLM指示服务器采取行动 → 例如重新安排会议、发送电子邮件

MCP如何工作:架构

MCP遵循简单的客户端-服务器架构:

MCP架构示意图:

MCP主机 <---> MCP客户端 <---> MCP服务器 <---> 本地/远程数据源

- MCP主机: 这些是需要访问外部数据或工具的应用程序(如Claude桌面版或AI驱动的IDE)

- MCP客户端: 它们与MCP服务器维持专用的一对一连接

- MCP服务器: 轻量级服务器通过MCP暴露特定功能,连接到本地或远程数据源

- 本地数据源: 由MCP服务器安全访问的文件、数据库或服务

- 远程服务: 由MCP服务器访问的基于互联网的外部API或服务

将MCP可视化为桥梁使其清晰明了: MCP本身不处理复杂逻辑;它只是协调AI模型与工具之间的数据和指令流。

就像USB-C简化了不同设备与计算机的连接方式一样,MCP简化了AI模型与您的数据、工具和服务的交互方式

实际中的MCP客户端

在实践中,MCP客户端(例如,client.py中的Python脚本)与管理特定工具(如Gmail、Slack或日历应用)交互的MCP服务器通信。

这种标准化消除了复杂性,让开发者能够快速启用复杂的交互。

MCP示例:何时使用MCP?

考虑以下场景:

1. 行程规划助手

- 使用API: 您需要为Google日历、电子邮件、航空公司预订API编写单独的代码,每个都有自定义的认证、上下文传递和错误处理逻辑

- 使用MCP: 您的AI助手可以顺畅地检查您的日历以了解可用性,预订航班,并发送确认邮件 - 全部通过MCP服务器,无需为每个工具进行自定义集成

2. 高级IDE(智能代码编辑器)

- 使用API: 您需要手动将IDE与文件系统、版本控制、包管理器和文档集成

- 使用MCP: 您的IDE通过单一MCP协议连接到这些工具,实现更丰富的上下文感知和更强大的建议

3. 复杂数据分析

- 使用API: 您手动管理与每个数据库和数据可视化工具的连接

- 使用MCP: 您的AI分析平台通过统一的MCP层自主发现并与多个数据库、可视化和模拟交互

实施MCP的好处

- 简化开发: 一次编写,多次集成,无需为每个集成重写自定义代码

- 灵活性: 切换AI模型或工具无需复杂重新配置

- 实时响应: MCP连接保持活跃,实现实时上下文更新和交互

- 安全性和合规性: 内置访问控制和标准化安全实践

- 可扩展性: 随着AI生态系统的增长轻松添加新功能—只需连接另一个MCP服务器

什么时候传统API更好?

如果您的用例需要精确、可预测的交互并有严格限制,传统API可能更可取。MCP提供广泛、动态的功能,非常适合需要灵活性和上下文感知的场景,但可能不太适合高度控制、确定性的应用。

在以下情况坚持使用细粒度API:

- 需要细粒度控制和高度特定、受限的功能

- 您偏好为性能优化而紧密耦合

- 您希望最大的可预测性,最小的上下文自主性

开始使用MCP:高级步骤

MCP集成:

- 定义功能: 明确概述您的MCP服务器将提供什么

- 实现MCP层: 遵循标准化的MCP协议规范

- 选择传输方式: 在本地(stdio)或远程(服务器发送事件/WebSockets)之间选择

- 创建资源/工具: 开发或连接您的MCP将暴露的特定数据源和服务

- 设置客户端: 在您的MCP服务器和客户端之间建立安全稳定的连接

总结

什么是MCP?

- MCP: 统一接口,供AI代理动态与外部数据/工具交互

- API: 传统方法,需要单独集成和更多手动监督

MCP架构示意图:

MCP主机 <---> MCP客户端 <---> MCP服务器 <---> 本地/远程数据源

MCP提供了一种统一和标准化的方式来集成AI代理和模型与外部数据和工具

结论

MCP提供了一种统一和标准化的方式来集成AI代理和模型与外部数据和工具。它不仅仅是另一个API;它是一个强大的连接框架,能够实现智能、动态和富有上下文的AI应用。